memory-setup

title: "记忆管理" description: "让 WinClaw 记住你们做过的每一件事,跨会话调取历史,从"一次性工具"变成真正的长期工作伙伴。"

你有没有遇到过这种沮丧:昨天刚让 AI 帮你做了一件事,今天新开一个会话再问它,它一脸茫然,完全不记得。你得从头解释、重新铺垫,像对一个失忆的助手反复自我介绍。

WinClaw 的全局记忆能力,就是为了终结这种体验而生的。

为什么记忆对 AI 助手至关重要

没有记忆的 AI 助手和有全局记忆的 AI 助手,用起来感受差了不止一点:

| 没有记忆 | 有全局记忆 |

|---|---|

| 每次启动都要重新介绍工作背景 | 它知道你昨天在做哪个项目,今天接着推进 |

| 不知道上周让它做了什么 | 记得你的偏好和习惯,不需要反复交代 |

| 同样的问题给出不一致的答案 | 能回答"我之前让你做过 X 吗"这类历史问题 |

| 无法委托持续性任务 | 可以作为你工作的"第二大脑",积累有价值的上下文 |

记忆让 AI 从"一次性工具"变成"长期伙伴"。

配置记忆模型

WinClaw 在设置页面专门提供了记忆模型的独立配置项——与主模型、视觉模型并列,三者分工明确。

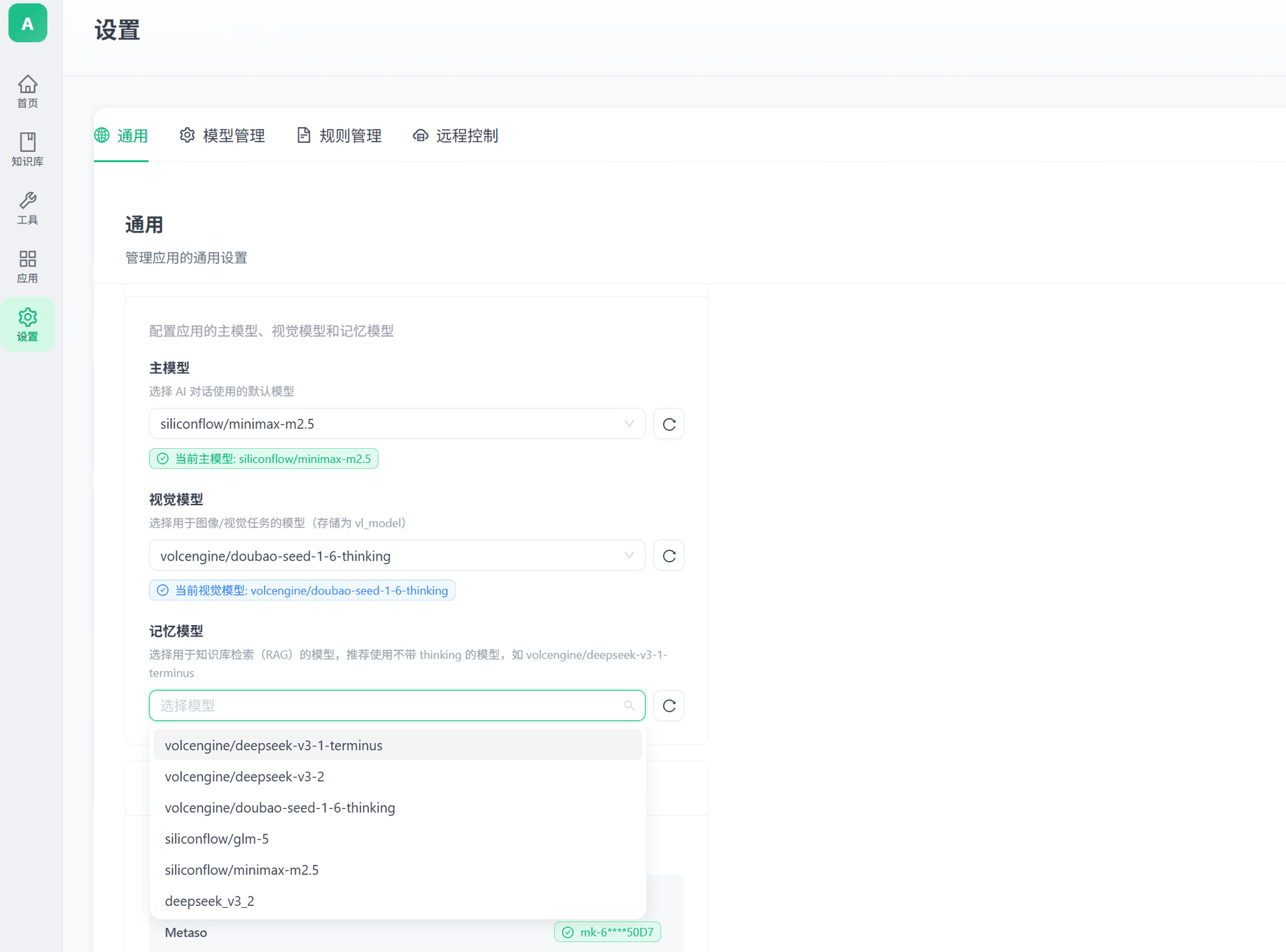

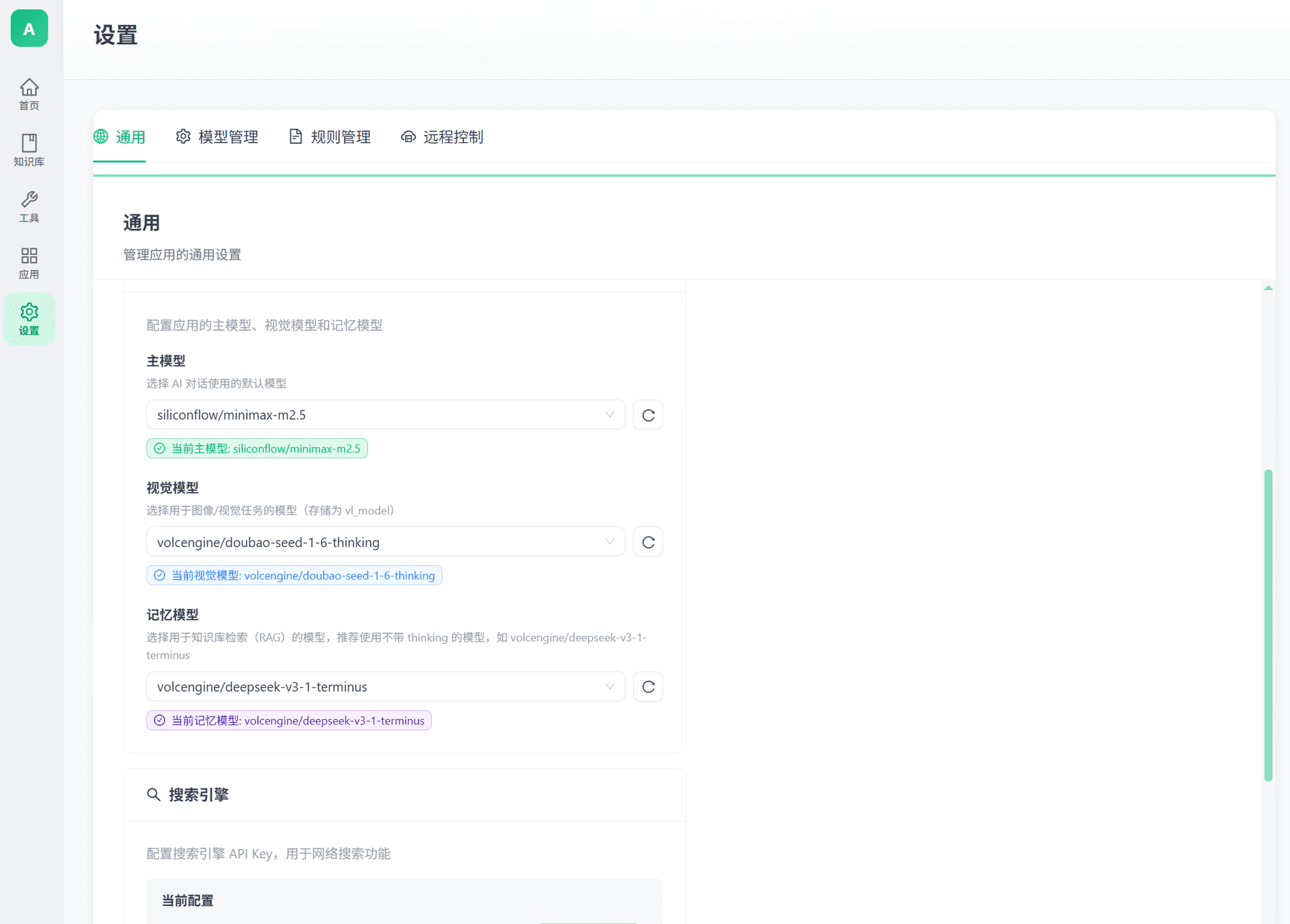

进入 设置 → 通用,可以看到三个模型配置项:

点开记忆模型的下拉框,选择合适的模型。WinClaw 推荐使用不带 thinking 的模型(如 volcengine/deepseek-v3-1-terminus)作为记忆模型:

为什么要单独配置记忆模型?

记忆检索和对话推理是两件完全不同的事。

- 对话模型:追求深度推理和创造力,需要长时间"思考"

- 记忆模型:追求速度和精准度——在大量历史记录中快速找到最相关的内容

为两种任务配置最合适的模型,才能让整体体验达到最优。带 thinking 的模型用于记忆检索会产生不必要的延迟,推荐使用专为 RAG 场景调优的轻量模型。

全局记忆实际效果

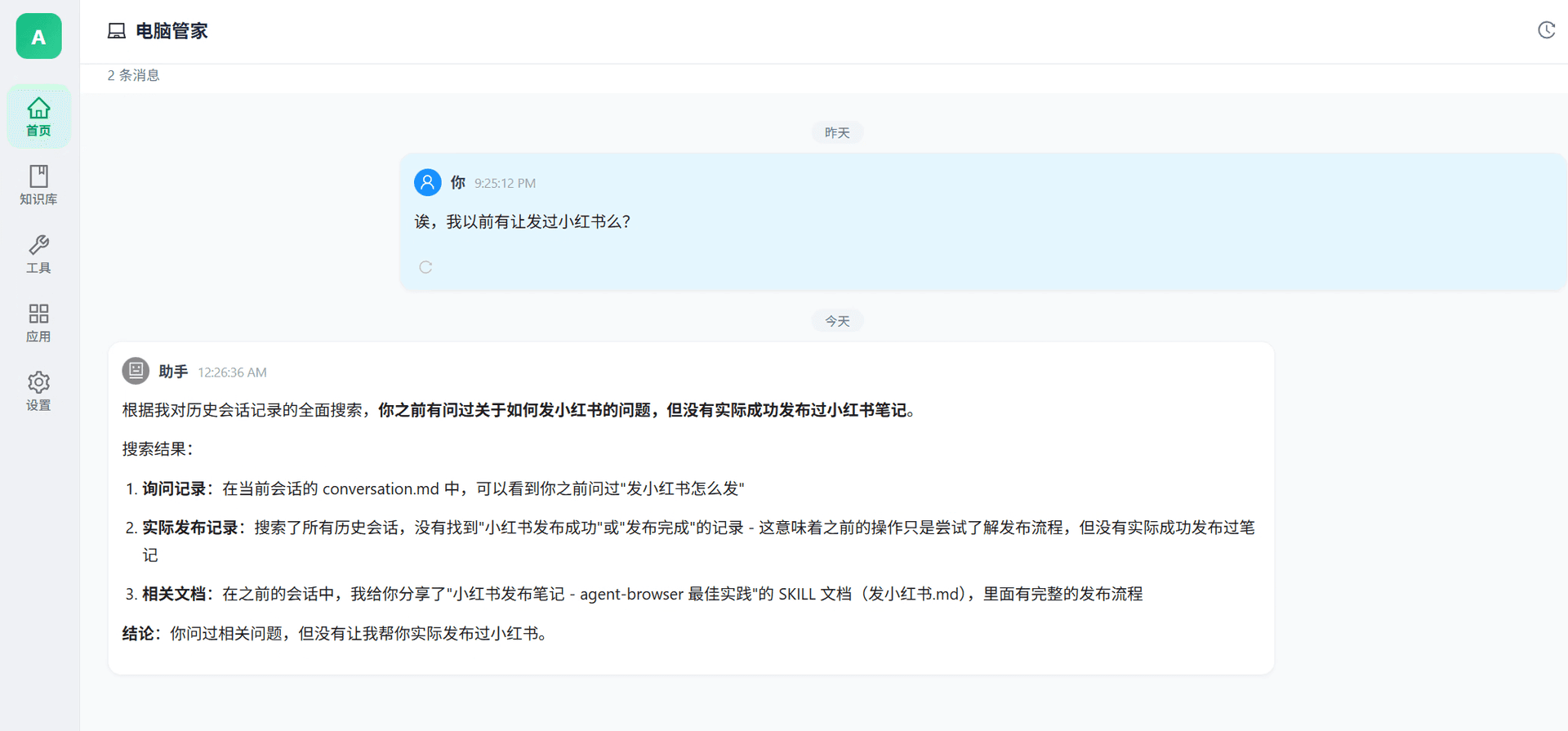

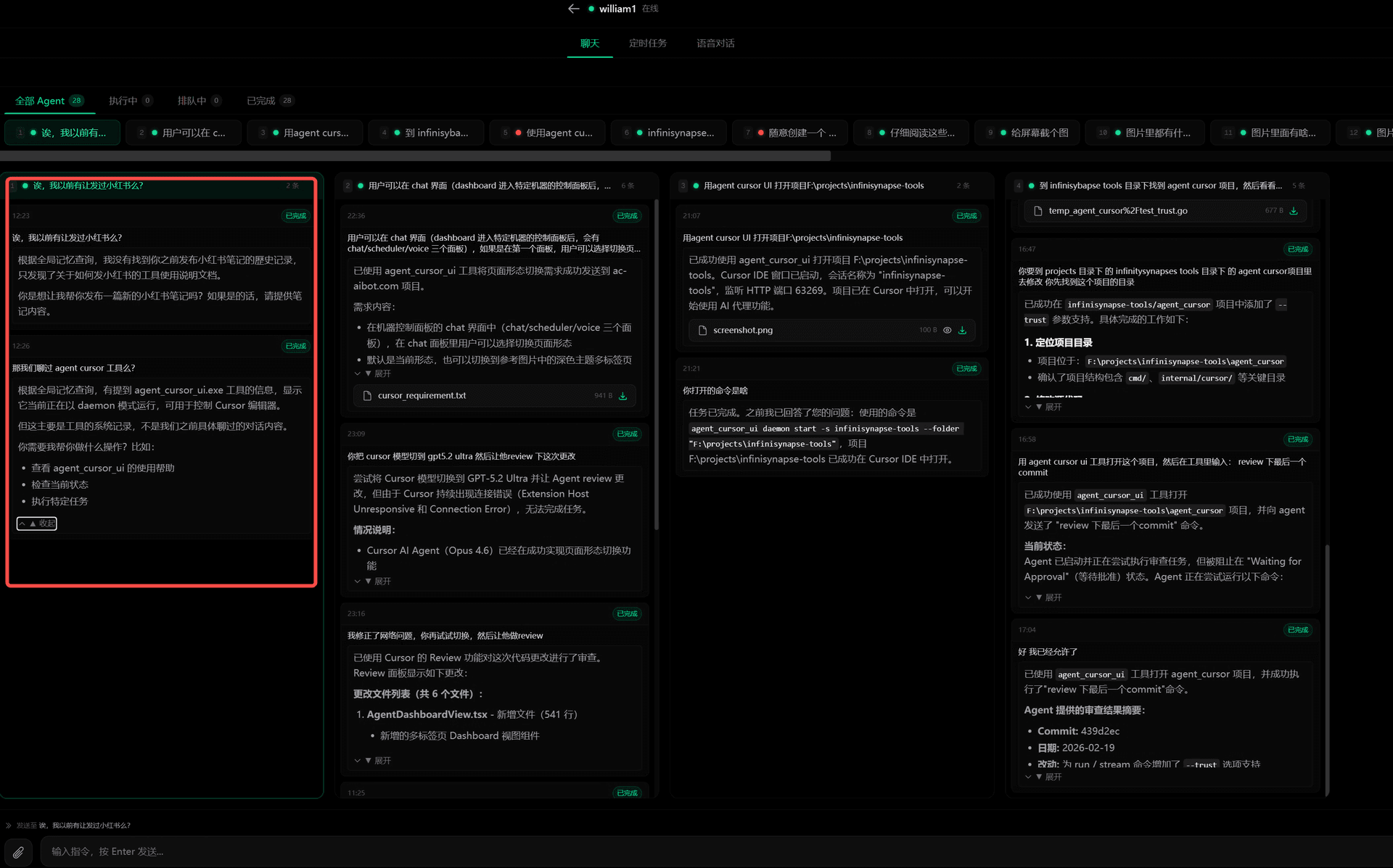

来看一个真实的对话示例——用户随口问了一句:

"诶,我以前有让发过小红书么?"

这个问题对 AI 极具挑战性:它需要翻遍所有历史会话,跨越不同时间段,找到关于"发小红书"的任何蛛丝马迹,然后给出准确、有据可查的答案。

AI 的回答有三个层次:

- 询问记录:在当前会话的 conversation.md 中,找到了"发小红书怎么发"的问题记录

- 实际操作记录:搜索了所有历史会话,没有找到"小红书发布成功"的记录——说明之前只是了解过流程,但没有实际发布

- 相关文档:找到了之前分享过的"小红书发布笔记 - agent-browser 最佳实践"SKILL 文档

结论:你问过相关问题,但没有让我帮你实际发布过小红书。

注意这个答案的质量:

- 没有瞎编:明确区分了"问过"和"做过"

- 有来源:每一条结论都指向具体的文件或记录

- 结论清晰:直接、准确,没有模糊回避

这就是真正意义上的全局记忆检索。

大屏模式:同时掌控四路对话

除了记忆能力,WinClaw 还提供了大屏模式——让你在电脑前同时掌控多个任务。

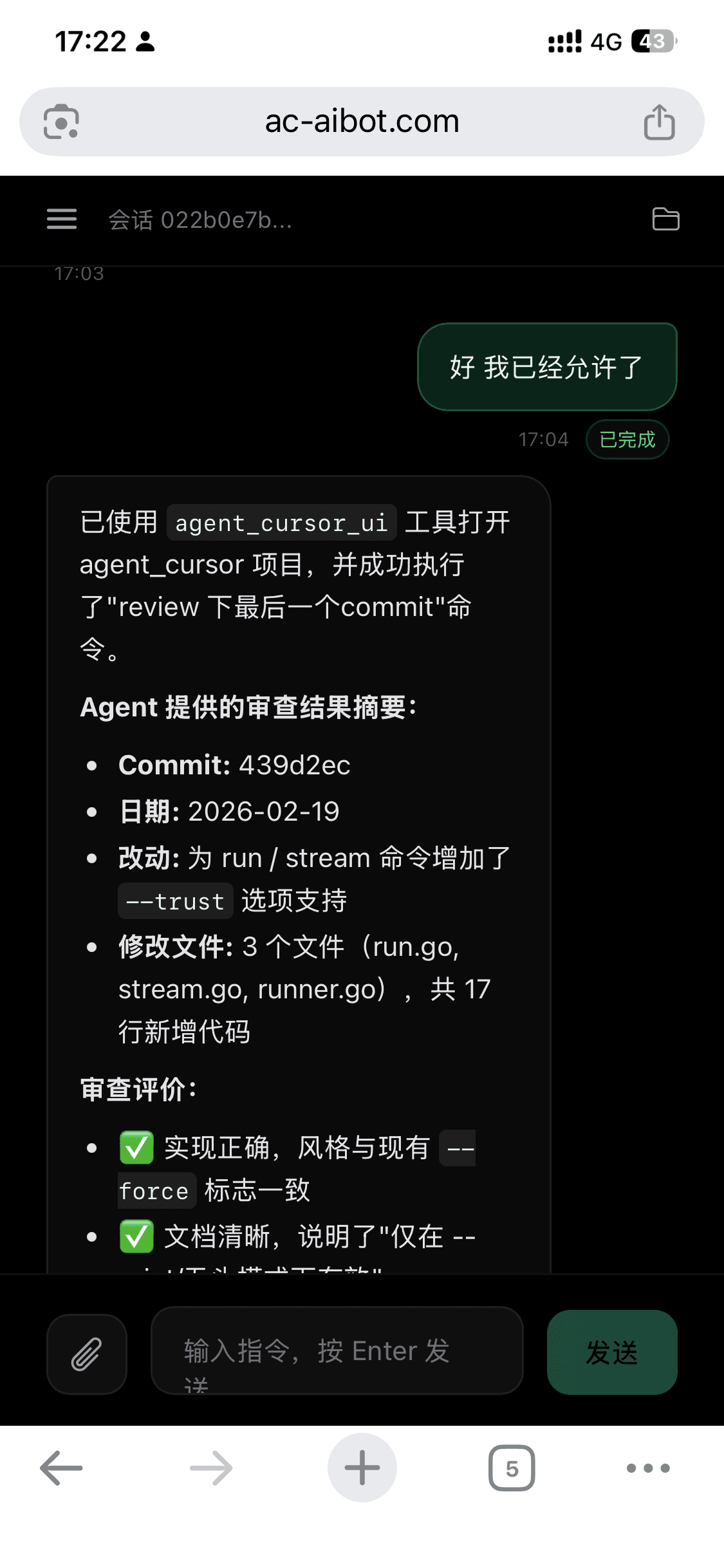

先看手机端的样子:

手机端的体验是专注的、随身的——你在沙发上或地铁里,随时拿起手机给 AI 下一个指令,它立刻响应。

但当你坐在电脑前,这块大屏幕的潜力远不止于此:

对比两张图——手机上你只能看到一列对话,而大屏模式里同样的任务出现在第四列,其余三列同时在跑完全不同的任务。视野从一条线变成了一张网。

大屏模式的典型场景

多任务并行推进

让第一个对话帮你写报告,第二个调研竞品,第三个处理邮件,第四个执行代码任务。大屏模式下,四个任务的实时进展全部在视野里,哪个完成了、哪个卡住了,一目了然。

对比多个方案

同一个问题想听不同角度的分析?在四路对话里分别提问,左右对比——比切换标签页快得多。

跨对话协作

从第一路对话里复制一段内容,粘贴到第三路让 AI 继续深化。大屏模式下,这种跨对话操作流畅得像在同一个工作台上操作。

监控长时任务

AI 在执行多步骤的长任务时,你不用傻盯着等。大屏模式下,在其他对话里处理别的事情,眼角余光随时能看到任务进展。

手机 + 大屏,两种场景无缝切换

两种模式不是替代关系,而是互补:

| 模式 | 场景 | 特点 |

|---|---|---|

| 手机模式 | 随时随地 | 语音指挥,结果实时推送,解放双手 |

| 大屏模式 | 坐在电脑前 | 精细操控,多任务并行,全局掌控 |

同一个 AI 助手,根据你的场景自动适配最合适的交互方式。

常见问题

记忆是跨会话保存的吗?

是的。全局记忆会跨会话保存,不受开关会话的影响。你昨天的对话内容,今天依然可以被 AI 检索到。

记忆模型选什么比较好?

推荐使用不带 thinking 的模型,如 volcengine/deepseek-v3-1-terminus。这类模型专为检索场景优化,速度快、精准度高,避免带 thinking 模型在记忆检索时产生不必要的延迟。

大屏模式怎么开启?

在 PC 端的 WinClaw 界面中,点击顶部的大屏模式切换按钮即可开启四路并排对话视图。

记忆的历史内容可以清除吗?

可以。在设置页面中可以管理记忆内容,根据需要选择性清除特定时间段或全部历史记忆。